2023智源大会议程公开丨AI开源论坛

应用介绍

将邀请这一领域的探索者、实践者、以及关心智能科学的每个人,共同拉开未来舞台的帷幕,你准备好了吗?与会知名嘉宾包括,图灵奖得主Yann LeCun、图灵奖得主Geoffrey Hinton、OpenAI创始人Sam Altman、图灵奖得主Joseph Sifakis、、2021年科学突破奖得主David Baker、2022吴文俊最高成就奖得主郑南宁院士和中国科学院院士张钹等

AI开源技术和数据资源的共享已经成为推动AI发展的关键力量。伴随着深度学习、机器学习等人工智能技术的不断进步,越来越多的开源工具、框架以及大规模的开源数据集涌现出来,为 AI 的研究和应用提供了丰富的土壤,推动了AI在语言、视觉、语音以及跨模态等领域的进步。特别地,开源大模型,如GPT、LLaMA等,在众多的下游任务中取得了重大突破,这为AI的未来发展打开了新的可能。可以预见,AI开源技术与数据将会在未来继续为学术界和工业界带来更多的机会和挑战。本次论坛邀请了AI开源和数据领域的知名专家,他们将就AI开源技术与平台建设、数据资源的管理和应用等问题进行深入的探讨,并带来一系列精彩的报告。

堵俊平,LF AI&DATA基金会主席(2022-2023)。Apache基金会成员、Apache Hadoop等项目的核心PMC 以及Committer。曾任世界五百强公司高管、硅谷著名创新公司的研发负责人等职务,在云计算、大数据和AI开源领域等领域具有长期的经验与影响力。

当下,AI与大语言模型迎来了爆发式的发展。在模型生态蓬勃发展的背后,做为模型最核心基础的数据,其痛点也不断被持续的发掘出来。如何获取高质量的数据,把模型与数据统一规范化治理,以及解决跨区域与跨云的数据与模型孤岛问题等成为各大企业在探索发挥AI模型价值的重大障碍,业界也亟需标准化的解决方案。演讲者将阐释各大痛点背后的实际影响,业界当前及潜在的应对方式,以及未来可能出现的技术趋势。

FlagOpen(飞智)大模型技术开源体系是由智源研究院与多家企业、高校和科研机构共建的一站式、高质量的大模型开源开放软件体系,包括大模型算法、模型、数据、工具、评测等重要组成部分,旨在建设大模型领域的“新Linux”生态。基于FlagOpen,国内外开发者可以快速开启各种大模型的尝试、开发和研究工作,企业可以低门槛进行大模型研发。同时,FlagOpen大模型基础软件开源体系正逐步实现对多种深度学习框架、多种AI芯片的完整支持,支撑AI大模型软硬件生态的百花齐放。本次报告将分享FlagOpen开源体系的最新成果和未来计划。

模型评测是模型生产生命周期中非常重要的一环,随着近年来基础模型相关理论和技术的高速发展,但传统的评测方法和基准在基础模型评测上正面临失效的困境,因此研发面向基础模型的评测方法和工具就显得更为重要。

FlagEval 大模型开源评测体系创新构建了“能力-任务-指标”三维大语言模型评测框架,尝试细粒度的刻画基础模型的认知能力边界。

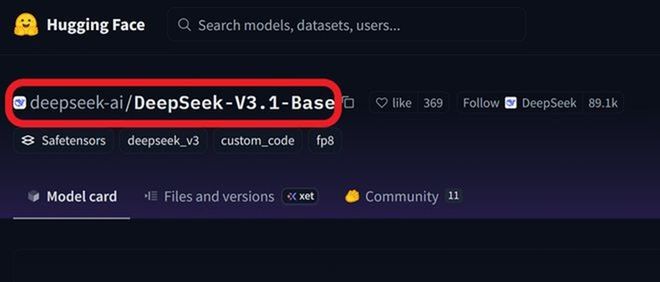

议题简介:过去的一年是人工智能领域高速发展的一年,我们看到了Stable diffusion和ChatGPT等令人兴奋的工作。HuggingFace开源社区在这精彩的一年中,同样与我们的合作伙伴以及社区贡献者加快了开发步伐,以保证更多人能受益于当下最前沿的机器学习技术。让我们一起总结HuggingFace在大型预训练模型、开源工具、机器学习应用及道德监管等方向的进展,并共同讨论HuggingFace的下一步。

议题简介:AI目前正处于螺旋上升式发展历史和重大变革机会,从感知理解世界到生成创造世界的AI增长曲线中,大规模语言模型(LLM)所涌现出来的超预期表现,使得LLM成为新的技术演进方向。尤其在商业化落地过程中,也对算力集群软硬件提出全新挑战。本次分享将会详细介绍AI大语言模型的开源生态发展,以及昇思大模型平台架构设计及应用,聚焦讨论行业机会和落脚点问题。

议题简介:Ray作为高速发展的开源项目,专注于解决人工智能和机器学习的核心问题,在OpenAI, Uber, 蚂蚁金服,字节跳动等公司均有产品级的部署。Ray提供数据预处理,模型训练,参数调优,推理,强化学习等多种模块。本次分享介绍Ray的发展历史,核心模块,以及开源社区的最新动态。

飞桨(PaddlePaddle)以百度多年的深度学习技术研究和业务应用为基础,是中国首个自主研发、功能完备、 开源开放的产业级深度学习平台,集深度学习核心训练和推理框架、基础模型库、端到端开发套件和丰富的工具组件于一体。目前,飞桨累计开发者535万,服务企业20万家,基于飞桨开源深度学习平台产生了67万个模型。本议题介绍飞桨平台及其开源社区建设的思考。

议题简介:目前AIGC技术生态已经开始从模型扩散到基础软件,向量数据库,作为链接AI模型与海量非结构化数据的桥梁,正发挥越来越重要的作用。本次分享将介绍 LLM + VectorDB + Prompt 架构,以及向量数据库如何为大模型赋能。

议题简介:强化学习作为机器学习领域中重要的训练范式,在机器人、自然语言、内容生成、自动驾驶、推荐系统中都发挥着极其重要的作用。OpenRL作为一个通用强化学习框架,通过统一的训练接口,同时支持单智能体,多智能体,自然语言等任务的训练。另外,OpenRL提供易用且可定制化的编程模式,既方便入门用户快速上手,又能为专业人员提供灵活的配置方式。未来,OpenRL将会在促进强化学习智能体开源和应用方面做出更多贡献。

议题简介:目前,大众对于ChatGPT的理解依然是一个黑盒,就像一个冰山一样,我们能看到能使用的只是它的一角,真正ChatGPT做大语言能力的涌现都只是一个猜测,并没有好的证明,但是它为我们探索知识统一表征和推理和世界认知和建模等问题解决提供了一条道路。中科闻歌在大模型方面做了多年的探索和尝试,主要面向多模态的内容理解和多模态的内容生成。目前,基于多年积累的高质量领域数据训练了面向媒体、安全、金融等领域的大语言模型,即雅意(YaYi)大模型。

兴通讯股份有限公司开源战略总监。从2016年开始,他就牵头中兴通讯人工智能领域的预研工作。他致力于AI和5G方向的研究,并在2018年被选为联合国国际电信联盟ITU-T ML5G WG3主席(机器学习应用于5G网络架构组)。同时他当选中国人工智能产业发展联盟总体组副组长及Linux AI & Data基金会董事会成员。

孟伟先生先后担任Linux基金会ODL项目的PTL及Adlik项目的mentor,并且在IETF及ITU-T立项及发布多项国际标准,涉及人工智能及网络功能虚拟化方向。同时,他以第一作者获得中国及国际专利授权30余件。

本科毕业于上海交通大学ACM试点班,清华大学-欧洲工商管理学院INSEAD高级工商管理硕士TIEMBA。连续创业者,曾先后创立并成功退出数字营销公司Puda Tech、极限钓鱼品牌 M&W Jigging。

大模型浪潮下的平台、框架、AI编译器和芯片架构 智源大会AI系统论坛Geoffrey Hinton、姚期智、张钹、Sam Altman等专家共线智源大会议程公开